Explorando as inovações técnicas do DeepSeek V3

January 7, 2025

Explorando as inovações técnicas do DeepSeek V3

O DeepSeek V3 consolidou-se como um forte concorrente entre os modelos de IA de código aberto, apresentando uma combinação impressionante de inovação e eficiência. Com 671 bilhões de parâmetros, mas apenas 37 bilhões ativados por token, o modelo foi projetado para otimizar o desempenho enquanto minimiza o consumo de recursos. Neste artigo, analisamos as principais inovações técnicas que diferenciam o DeepSeek V3 de seus concorrentes.

Principais recursos técnicos

Arquitetura Mixture‑of‑Experts (MoE)

No núcleo do DeepSeek V3 está a arquitetura Mixture‑of‑Experts (MoE). Esse design sofisticado permite ao modelo utilizar várias redes menores e específicas por tarefa que trabalham de forma colaborativa. Quando chega uma consulta, uma rede de gating decide quais especialistas ativar, garantindo que apenas os componentes necessários sejam utilizados. Essa ativação seletiva melhora significativamente a eficiência e o desempenho.

Multi‑head Latent Attention (MLA)

O DeepSeek V3 emprega Multi‑head Latent Attention (MLA) para aprimorar a compreensão de contexto e a extração de informações. Essa abordagem mantém alto desempenho e, por meio de técnicas de compressão de baixo posto, reduz o uso de memória durante a inferência. Como resultado, o modelo processa consultas complexas de forma eficiente, preservando a precisão.

Balanceamento de carga sem perda auxiliar

Uma das inovações de destaque do DeepSeek V3 é a estratégia de balanceamento de carga sem perda auxiliar. Métodos tradicionais de balanceamento podem afetar negativamente o desempenho do modelo; esta abordagem inovadora minimiza tais impactos, tornando o treinamento mais estável e eficiente.

Objetivo de previsão multi‑token

O DeepSeek V3 introduz um objetivo de treinamento de previsão multi‑token, que aprimora a capacidade de gerar texto coerente e contextual. Essa funcionalidade permite prever vários tokens simultaneamente, aumentando a velocidade de geração e a eficiência geral.

Métricas de desempenho

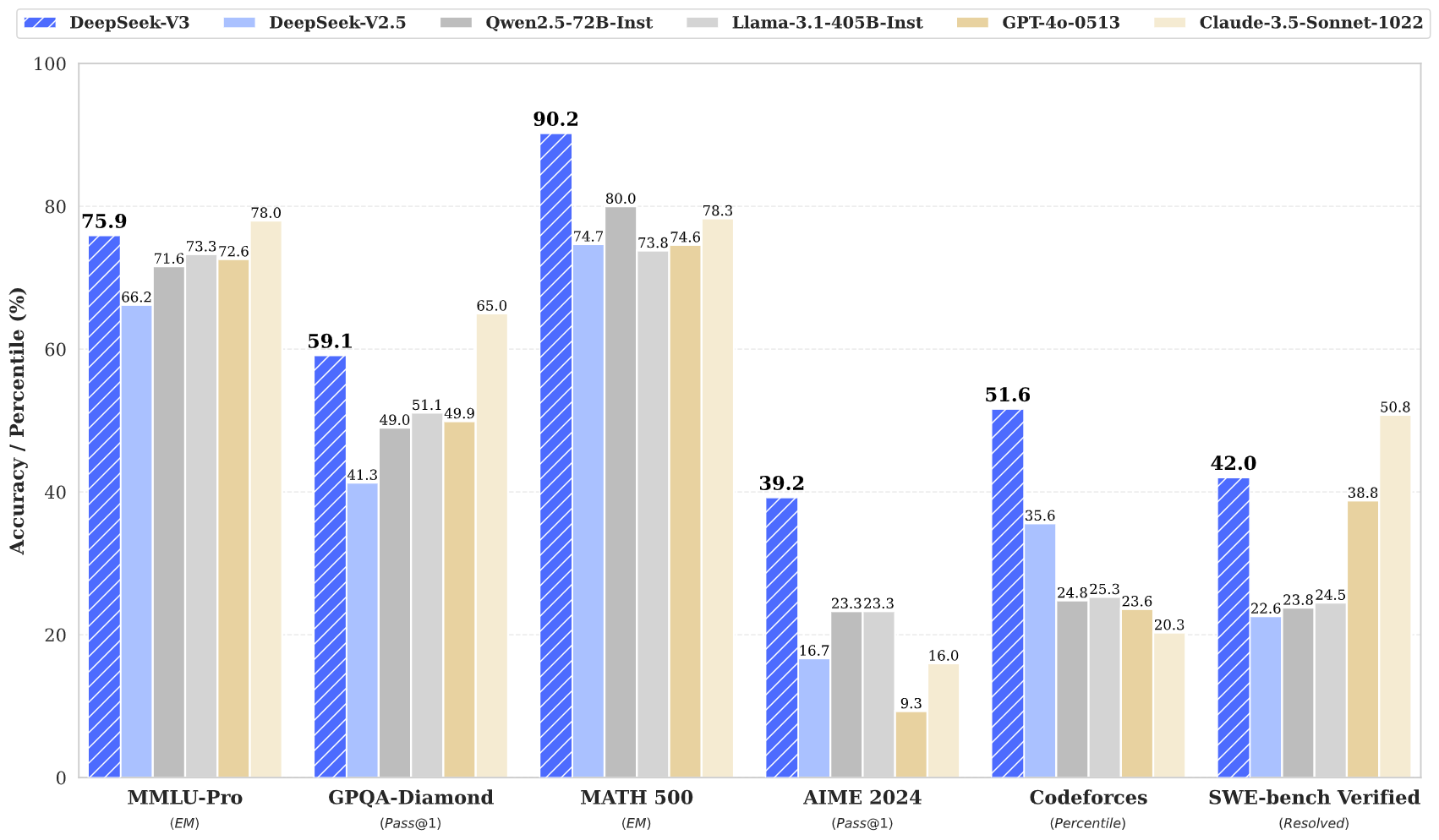

O DeepSeek V3 demonstrou desempenho excepcional em diversos benchmarks:

- MMLU: 87,1%

- BBH: 87,5%

- DROP: 89,0%

- HumanEval: 65,2%

- MBPP: 75,4%

- GSM8K: 89,3%

Essas métricas indicam que o DeepSeek V3 não apenas compete, como frequentemente supera modelos líderes de código fechado, como GPT-4 e Claude 3.5, especialmente em tarefas de raciocínio complexo e desafios de programação.

Eficiência de treinamento

O treinamento do DeepSeek V3 foi realizado com notável eficiência:

- Custo total de treinamento: Aproximadamente US$ 5,6 milhões

- Duração do treinamento: 57 dias

- Horas de GPU necessárias: 2,788 milhões de horas de GPU H800

Essa abordagem econômica evidencia como arquiteturas inovadoras podem gerar economias significativas em comparação com modelos tradicionais, que geralmente exigem muito mais recursos.

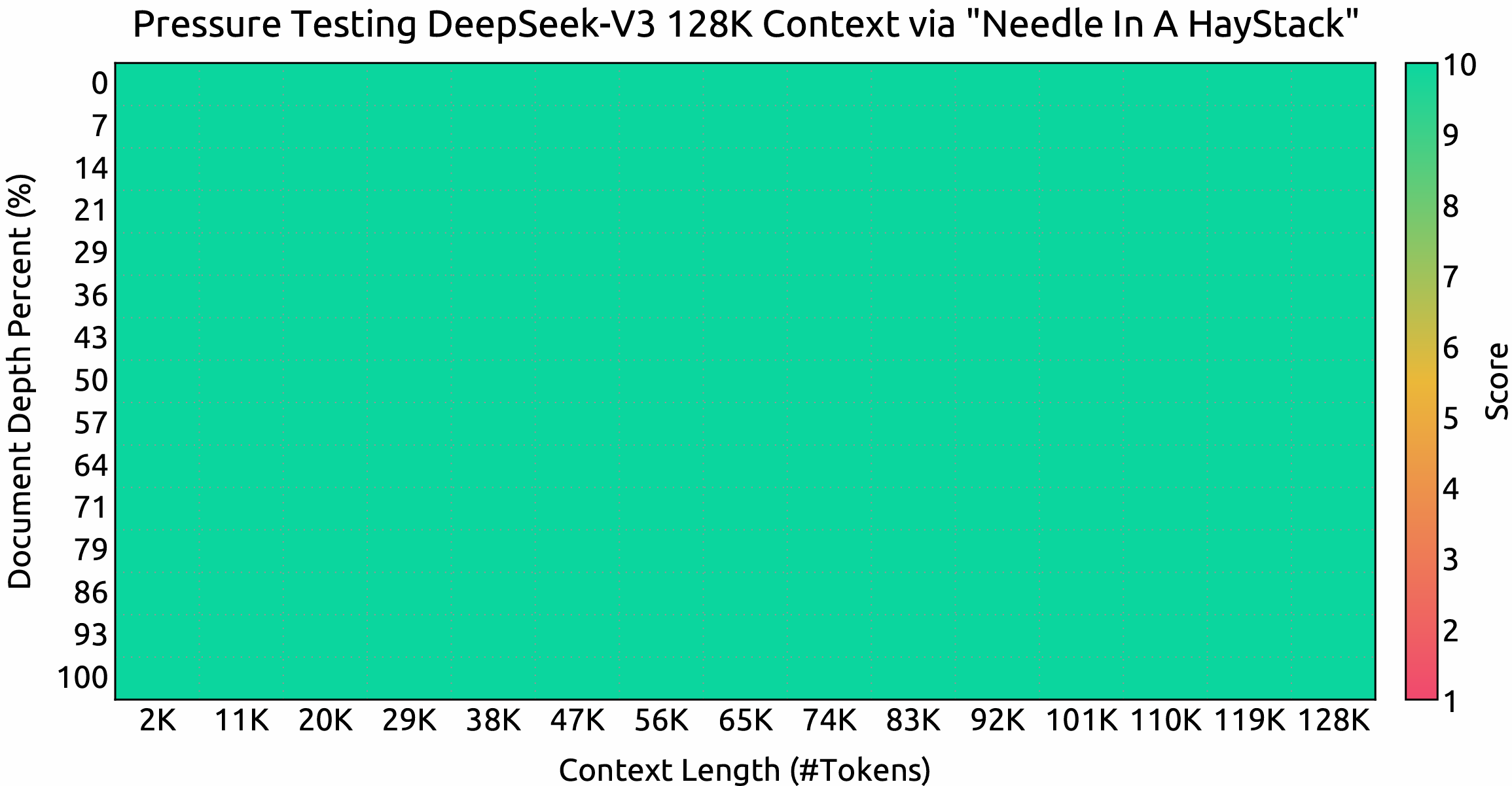

Janela de contexto e velocidade

O DeepSeek V3 suporta uma impressionante janela de contexto de 128.000 tokens, permitindo lidar com conteúdos longos e tarefas complexas de forma eficaz. Além disso, atinge uma velocidade de geração de até 90 tokens por segundo, figurando entre os modelos mais rápidos disponíveis atualmente.

Conclusão

Em resumo, o DeepSeek V3 representa um avanço revolucionário na IA de código aberto. Suas arquiteturas inovadoras — MoE e MLA — combinadas com estratégias de treinamento eficientes e métricas de alto desempenho, tornam-no um forte concorrente. Com a crescente demanda por soluções de IA poderosas e acessíveis, o DeepSeek V3 está bem posicionado para liderar a democratização da tecnologia de IA.

O DeepSeek V3 marca um importante marco no desenvolvimento de IA open source, combinando arquitetura de ponta com notável eficiência. Suas métricas e inovações demonstram que é possível desenvolver modelos de alta qualidade a uma fração do custo tradicional, tornando a IA avançada mais acessível à comunidade em geral.